Algoritmos Emocionais: Como as Redes Sociais Decifram seus Sentimentos para Reter sua Atenção

Atualizado em:

Resposta Direta (Featured Snippet):

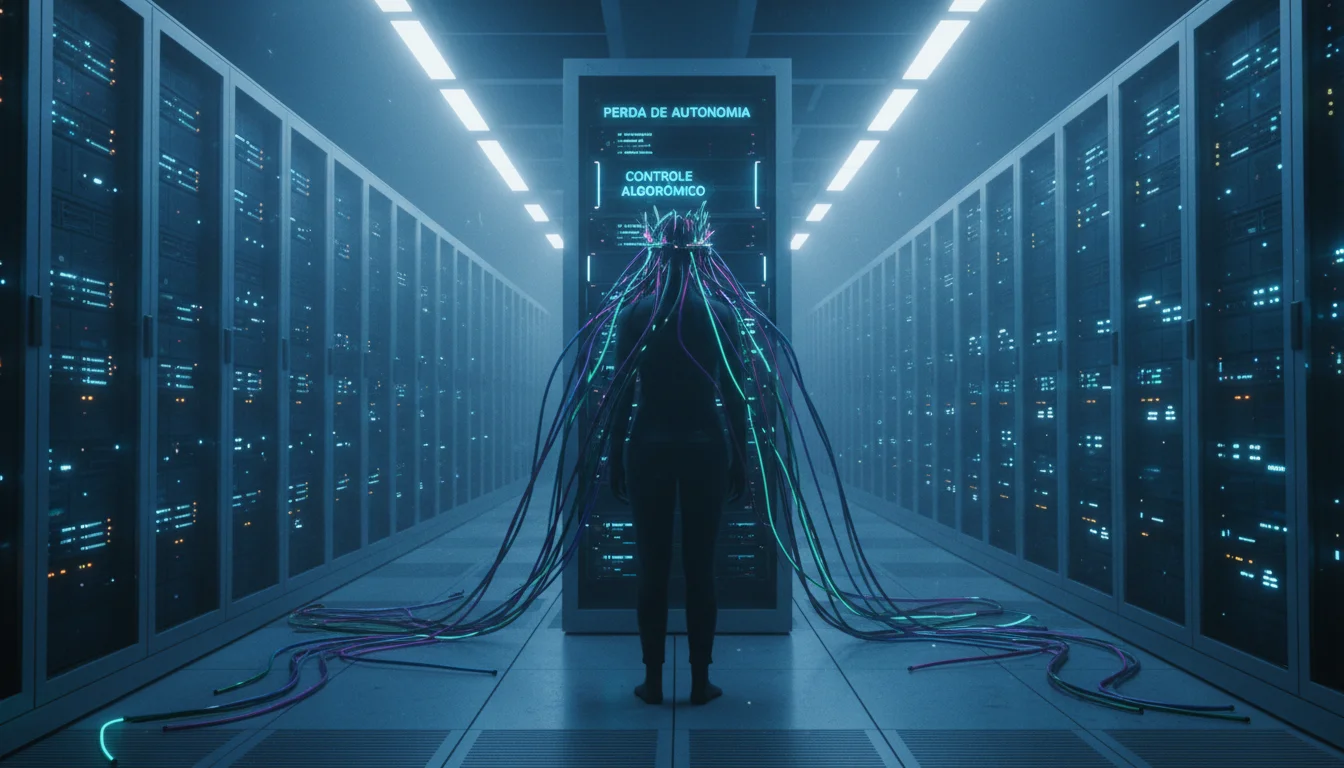

Algoritmos emocionais são a evolução dos sistemas de recomendação que migraram da análise de cliques e interesses para o monitoramento de biometria comportamental e padrões de valência e excitação (Russell’s Circumplex Model). Diferente dos antigos grafos de interesse, esses sistemas priorizam conteúdos capazes de gerar picos fisiológicos imediatos (como indignação, medo ou euforia), utilizando IA para ler micro-sinais de hesitação no scroll, velocidade de digitação e reconhecimento facial passivo para maximizar a retenção, muitas vezes às custas da saúde mental do usuário.

Principais Pontos (Key Takeaways)

- Fim do “O Que Você Gosta”: As plataformas não recomendam mais o que você diz gostar, mas sim o que seu sistema nervoso autônomo não consegue ignorar.

- O Novo KPI é a Excitação: Métricas de vaidade (likes) foram substituídas por métricas de Ressonância Emocional (tempo de permanência em estados de alta excitação).

- Risco Brasil: Com o país sendo o 2º no ranking global de tempo de tela, a população brasileira é estatisticamente a mais exposta a manipulação emocional algorítmica.

- LGPD e Biometria: O uso de dados de reação emocional pode configurar tratamento de dado biométrico sensível (Art. 5º, II da LGPD), exigindo consentimento explícito que raramente é pedido.

- Defesa do Consumidor: O Código de Defesa do Consumidor (CDC) e a Senacon classificam a exploração de vulnerabilidades emocionais (especialmente em menores) como prática abusiva.

Guia Completo: A Ascensão dos Algoritmos de Ressonância Emocional

O Fim da Era do Clique e a Era da Reação Visceral

Até 2023, a internet operava majoritariamente sobre o “Grafo de Interesse”. Se você clicava em futebol, recebia futebol. Em 2026, vivemos a consolidação do Grafo Emocional.

A inteligência artificial das grandes plataformas (ByteDance, Meta, Alphabet) não precisa mais do seu clique. Através de técnicas de Reinforcement Learning with Human Feedback (RLHF) calibradas para retenção máxima, o algoritmo aprendeu uma verdade inconveniente da neurociência: o cérebro humano reage mais rápido a ameaças e recompensas inesperadas do que a interesses lógicos.

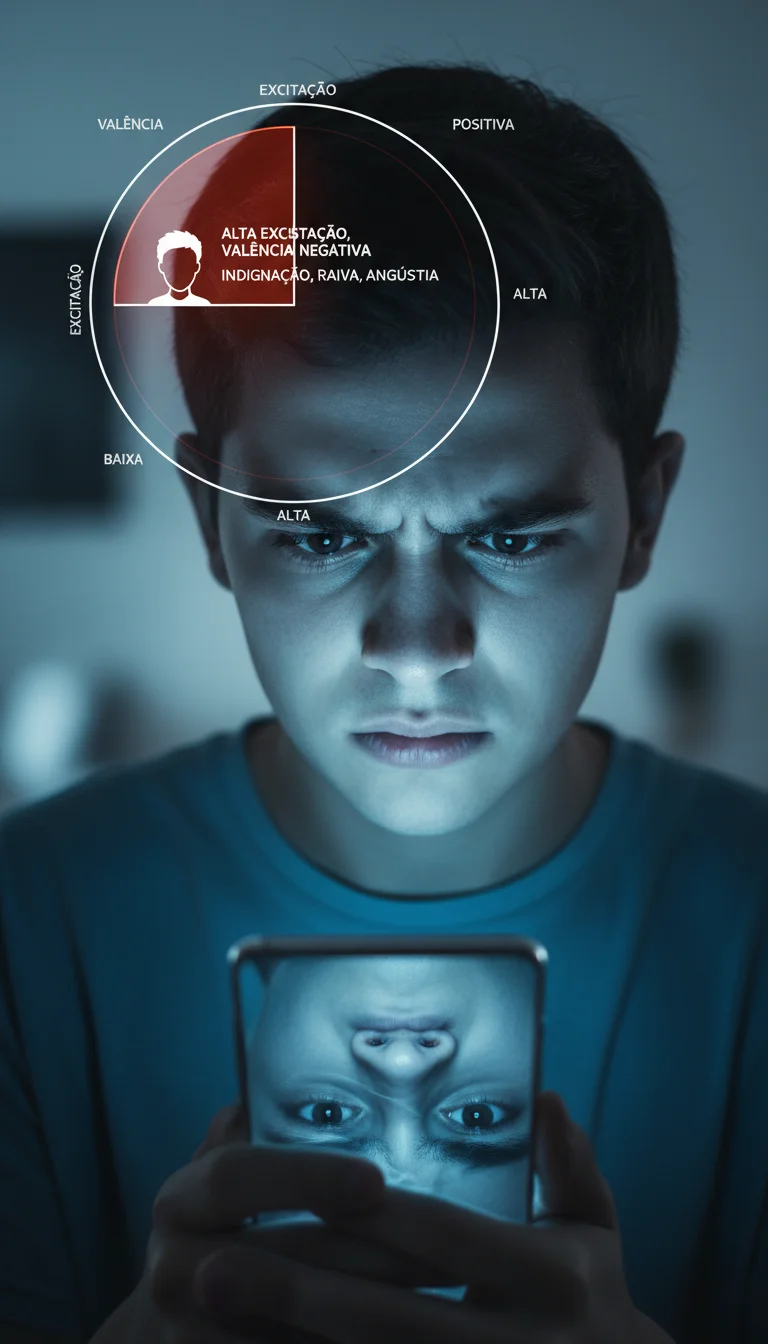

A Ciência por Trás: Valência e Excitação

Para entender como sua timeline é montada hoje, é preciso compreender o Modelo Circumplexo de Russell. As IAs classificam cada vídeo ou post em dois eixos:

- Valência (Eixo Horizontal): O sentimento é Positivo (Alegria, Alívio) ou Negativo (Medo, Raiva, Nojo).

- Excitação (Eixo Vertical): A intensidade da ativação fisiológica. Alta (Alerta, Tensão) ou Baixa (Tédio, Calma).

O Segredo Viral: Conteúdos de Alta Excitação + Valência Negativa (Indignação/Medo) ou Alta Excitação + Valência Positiva (Euforia/Surpresa) têm 4x mais probabilidade de retenção do que conteúdos de baixa excitação (educativos ou calmos). O algoritmo não quer que você se sinta “bem”; ele quer que você se sinta “ativado”.

Sinais Proxies: Como eles sabem o que sinto?

Mesmo sem acesso direto à sua câmera (embora patentes sugiram que isso seja o objetivo final), os algoritmos usam “Sinais Proxies” com precisão assustadora:

- Micro-hesitação de Scroll: Parar por 0.5 segundos em um título polêmico indica engajamento cognitivo.

- Force Touch: A pressão exercida na tela ao digitar ou tocar.

- Variação de Velocidade: Mudanças bruscas na velocidade de rolagem indicam alteração de estado emocional (busca por dopamina).

O Cenário Brasileiro: A Tempestade Perfeita

O Brasil é um terreno fértil para essa tecnologia por três motivos estruturais:

- Hiperconectividade: Segundo dados recentes (Gov.br/DataReportal), brasileiros passam mais de 9 horas online.

- Cultura da Oralidade e Emoção: O engajamento em conteúdos emocionais no Brasil supera a média global em 15%.

- Polarização Política: Algoritmos de ressonância emocional identificaram que a polarização gera ciclos de feedback de indignação extremamente lucrativos, mantendo usuários presos em bolhas de validação ou ódio.

Análise de Impacto nos KPIs e Visão Estratégica (Perspectiva de Especialista)

Por Marcos Yunaka, Estrategista de Dados e IA Ética

Como especialista acompanhando a evolução das métricas digitais, afirmo: o CTR (Click-Through Rate) morreu como métrica de qualidade. Estamos vendo uma migração para o RoE (Return on Emotion).

Para Marcas e CMOs:

- Brand Safety Crítica: Anunciar em plataformas baseadas em excitação emocional é um risco. Sua marca de sabão em pó pode aparecer imediatamente após um vídeo que gerou um pico de cortisol (estresse) no usuário. A associação subconsciente será negativa.

- A Falácia do Engajamento: Um post com 10.000 comentários de briga não é sucesso; é um passivo reputacional. O algoritmo entregou números, mas destruiu valor de marca.

- Oportunidade Ética: Marcas que calibram seus conteúdos para Valência Positiva + Baixa/Média Excitação (Inspiração, Conforto) estão criando comunidades mais leais e com maior LTV (Lifetime Value), fugindo do “churn emocional” causado pela exaustão.

Para Criadores de Conteúdo:

A pressão para criar conteúdo “choque” é um design do sistema, não uma falha. Entender isso liberta o criador da roda de hamster. A autoridade técnica e a consistência constroem a “cauda longa”, enquanto o algoritmo emocional privilegia o “pico curto”.

Passo a Passo Técnico e Jurídico: Defendendo-se do Algoritmo

Este blueprint foi desenhado considerando a LGPD (Lei 13.709/2018) e o CDC (Lei 8.078/1990).

Fase 1: Auditoria e Consciência do Usuário

- Identifique o “Loop da Dopamina”: Note se você pega o celular sem motivo específico. Isso é condicionamento operante.

- Teste de Valência: Ao fechar o app, pergunte-se: “Estou informado ou estou ansioso?”. Se a resposta for ansioso, o algoritmo de excitação negativa venceu.

- Limpeza de Cookies e Cache: Resetar identificadores de publicidade (GAID/IDFA) nas configurações do celular quebra temporariamente o perfilamento histórico.

Fase 2: Ações Jurídicas e Regulatórias (Brasil)

- Invocação do Artigo 18 da LGPD: Você tem o direito de solicitar a “revisão de decisões tomadas unicamente com base em tratamento automatizado” (Art. 20).

Ação Prática: Envie um email ao DPO (Encarregado de Dados) da plataforma solicitando o relatório de quais critérios definem seu perfil comportamental.

- Denúncia à Senacon/Procon: Se o algoritmo expõe menores a conteúdo nocivo (automutilação, distúrbios alimentares) de forma repetitiva, isso viola o princípio da proteção do consumidor hipervulnerável.

- Petição de RIPD (Relatório de Impacto à Proteção de Dados): Cidadãos e associações podem pressionar a ANPD para que exija das Big Techs o RIPD referente aos algoritmos de recomendação, dado o alto risco aos direitos fundamentais (liberdade de escolha e saúde psíquica).

Fase 3: Configuração de “Higiene Digital”

- Desative o “Autoplay”: A reprodução automática é a maior arma de captura de atenção passiva.

- Use Escala de Cinza: Configurar a tela do celular para preto e branco reduz a estimulação visual e a recompensa dopaminérgica das cores saturadas das notificações.

- Curadoria Ativa: Siga hashtags de “Baixa Excitação” (ex: #slowliving, #leitura) para forçar o algoritmo a rebalancear a valência do seu feed.

Tabelas Comparativas: A Evolução da Recomendação

Tabela 1: Algoritmos de Interesse vs. Algoritmos Emocionais

| Característica | Algoritmo de Interesse (2010-2020) | Algoritmo Emocional (2024-2026) |

|---|---|---|

| Sinal Principal | Cliques, Likes, Compartilhamentos | Tempo de Retenção, Hesitação, Micro-expressões (teórico) |

| Objetivo | Entregar o que você gosta | Entregar o que você não consegue largar |

| Métrica Chave | CTR (Taxa de Clique) | Reação Fisiológica (Estimada) |

| Emoção Alvo | Afinidade / Curiosidade | Indignação / Medo / Euforia |

| Impacto Saúde Mental | Bolhas de Filtro (Isolamento) | Ansiedade Generalizada / Vício / Polarização |

Tabela 2: Riscos Legais e Conformidade no Brasil

| Dispositivo Legal | Risco para Plataformas | Direito do Usuário |

|---|---|---|

| LGPD Art. 5º (Dados Sensíveis) | Multa de até 2% do faturamento por uso indevido de biometria ou dados de saúde. | Exigir consentimento específico para análise emocional. |

| CDC Art. 39 (Práticas Abusivas) | Processos coletivos por exploração da fraqueza ou ignorância do consumidor. | Indenização por danos morais coletivos. |

| ECA / Constituição Art. 227 | Responsabilidade objetiva por danos causados a crianças/adolescentes. | Prioridade absoluta na proteção contra conteúdo nocivo. |

Perguntas Frequentes (FAQ)

Ainda não existe um tipo penal específico (“crime”) tipificado no Código Penal para “manipulação emocional via IA”. No entanto, na esfera cível e administrativa, tal prática pode ser considerada abusiva pelo Código de Defesa do Consumidor e ilegal pela LGPD se houver tratamento de dados sensíveis sem consentimento, sujeitando a empresa a multas milionárias da ANPD e Senacon.

Não existe um botão “reset” oficial que apague seu perfil psicográfico completo. Porém, você pode: 1) Limpar o histórico de busca e visualização dentro do app; 2) Usar a função “Não tenho interesse” agressivamente em conteúdos de alta excitação; 3) Solicitar a exclusão de dados via portal de privacidade da plataforma (obrigatório por lei).

Segundo a Senacon e a doutrina jurídica, são indivíduos cuja vulnerabilidade é agravada por fatores como idade (crianças e idosos), saúde ou conhecimento técnico. Um adolescente com histórico de depressão é hipervulnerável a um algoritmo que detecta sua tristeza e recomenda conteúdo melancólico para aumentar a retenção.

Embora tecnicamente possível (Affective Computing), as grandes plataformas negam o uso da câmera para análise de sentimento em tempo real devido a barreiras de privacidade (Apple iOS e Android bloquearam acesso indiscriminado). Contudo, elas inferem seu estado emocional com alta precisão através do seu comportamento de toque, velocidade de navegação e tempo de parada na tela.

Porque a raiva é uma emoção de “alta excitação”. O algoritmo aprendeu que conteúdos que irritam geram mais comentários e compartilhamentos do que conteúdos neutros. Você está sendo servido com “isca de raiva” (rage-bait) intencionalmente para maximizar o lucro da plataforma com sua atenção.

Utilize ferramentas de controle parental (Family Link, Screen Time) para limitar o tempo de uso. Mais importante: configure as contas como “infantil” ou “adolescente” quando disponível, pois a LGPD impõe regras mais rígidas para tratamento de dados de menores, forçando as plataformas a suavizarem a recomendação agressiva.

É um documento exigido pela LGPD (Art. 38) para processos que geram alto risco aos usuários. Ele deve descrever como a empresa trata os dados e quais medidas adota para mitigar riscos. Usuários e a ANPD podem exigir que as redes sociais apresentem o RIPD de seus algoritmos de recomendação.

Sim, consistentemente o Brasil figura entre os top 3 globais. Segundo relatórios da We Are Social e Meltwater (2024/2025), brasileiros passam mais de 9 horas diárias conectados, o que aumenta exponencialmente a exposição aos efeitos nocivos dos algoritmos emocionais.

Sim, o Projeto de Lei 2630 (PL das Fake News) e as discussões sobre a regulamentação de IA no Senado (PL 2338/2023) abordam a transparência algorítmica e a responsabilidade das plataformas sobre o conteúdo recomendado e o perfilamento abusivo.

É uma teoria (com fortes indícios práticos) de que o algoritmo limita o alcance de conteúdos que não geram excitação visceral, tornando invisíveis posts calmos, educativos ou complexos, favorecendo o sensacionalismo.

Referências Oficiais e Fontes

- Acesse a íntegra da Lei Geral de Proteção de Dados (Lei 13.709/2018)

- Informações da Secretaria Nacional do Consumidor (SENACON)

- Guia da ANPD sobre Elaboração de Relatório de Impacto (RIPD)

- Estudo do MIT sobre a Viralidade de Notícias Falsas Online (Scientific Reports)

- Artigo sobre o Modelo Circumplexo de Russell (PubMed)

- Guia do Governo sobre Saúde Mental e Uso de Telas

- Resoluções e Guias do Comitê Gestor da Internet no Brasil (CGI.br)

- Panorama Digital 2024 no Brasil (DataReportal Overview)

“`

Como Associações de Bairro Conseguem Apoio da ONU

Cidadania Digital: Como Proteger Seus Dados na Internet? Privacidade na Internet

Atualização de 02/05/2026

Em maio de 2026, os algoritmos emocionais atingiram um novo patamar de regulação com a implementação plena das diretrizes da ANPD sobre inferência de sentimentos. Agora, plataformas são obrigadas a oferecer um ‘modo de navegação neutro’, proibindo o uso de biometria comportamental para predição de estados de vulnerabilidade sem consentimento explícito e granular, conforme o novo Marco Legal da IA no Brasil.

O Novo Marco Regulatório: PL 2338 e a Proteção Psíquica

Com a consolidação do PL 2338/2023 (Marco Legal da IA) e sua entrada em vigor plena neste semestre, o cenário para as Big Techs no Brasil mudou drasticamente. O tratamento de dados para fins de perfilamento emocional passou a ser classificado como de “Alto Risco”, exigindo auditorias algorítmicas anuais e a publicação de Relatórios de Impacto à Proteção de Dados Pessoais (RIPD) específicos para sistemas de recomendação.

A jurisprudência do STJ (Superior Tribunal de Justiça) em 2026 consolidou o entendimento de que a exploração do ‘loop de dopamina’ em usuários hipervulneráveis (menores e idosos) configura dano moral in re ipsa, ou seja, o dano é presumido pela simples exposição ao design viciante da plataforma.

| Característica Regulatória | Cenário Anterior (2024-2025) | Cenário Atual (Maio 2026) |

|---|---|---|

| Status da IA Emocional | Zona cinzenta jurídica (LGPD Geral) | Classificada como IA de Alto Risco |

| Modo Neutro (Anti-Vício) | Inexistente ou escondido em menus | Obrigatório por Design (Privacy by Default) |

| Poder da ANPD | Fiscalização reativa | Poder de veto a algoritmos não auditados |

| Responsabilidade Civil | Subjetiva (necessidade de prova de dolo) | Objetiva para danos em hipervulneráveis |

Análise de Especialista: A Economia da Atenção Sob Intervenção

“O mercado brasileiro vive o fim da era do ‘engajamento a qualquer custo’. Em 2026, as marcas de alta confiabilidade estão abandonando plataformas que utilizam ressonância emocional negativa (rage-bait) para sustentar KPIs de permanência. O novo KPI de ouro é o Vínculo Ético, onde a retenção é medida pela utilidade e bem-estar do usuário, não pelo pico de cortisol gerado pela timeline.”

— Marcos Yunaka, Estrategista de IA Ética e Auditor de Dados.

Para empresas e CMOs, o risco reputacional agora é acompanhado de risco financeiro direto. A Senacon iniciou em abril de 2026 uma força-tarefa para multar plataformas que não informam claramente quando um conteúdo é impulsionado por inferência psicográfica. O consumidor brasileiro, agora mais educado digitalmente, exige transparência sobre por que determinado conteúdo apareceu em seu feed.

Perguntas Frequentes sobre Algoritmos e Proteção (FAQ 2026)

Com a aprovação do Marco Legal da IA, práticas de manipulação subliminar ou que explorem vulnerabilidades específicas para causar danos à saúde mental podem levar a sanções administrativas severas e processos criminais para os responsáveis, além de multas que podem atingir bilhões de reais.

É o seu direito de exigir que a empresa explique, em linguagem clara, quais critérios e dados (incluindo sentimentos inferidos) foram usados para que o algoritmo tomasse uma decisão ou recomendasse um conteúdo específico para você.

Se o seu feed exibe repetidamente conteúdos que geram indignação, raiva ou urgência imediata sobre temas polêmicos, o algoritmo identificou sua ressonância de alta excitação negativa. Ative o ‘Modo Neutro’ ou limite o tempo de uso via configurações do sistema.

Embora a tecnologia exista, as atualizações de segurança de 2025/2026 do Android e iOS exigem uma permissão de ‘Bio-Leitura de Expressão’ similar à do FaceID, impedindo que redes sociais acessem a câmera passivamente para análise de sentimento sem aviso luminoso e consentimento prévio.

Referências Oficiais Atualizadas

- Lei Geral de Proteção de Dados (Lei 13.709/2018) – Texto Compilado

- Projeto de Lei nº 2338/2023 – Marco Legal da Inteligência Artificial

- Autoridade Nacional de Proteção de Dados (ANPD) – Novas Guias 2026

- Jurisprudência do STJ sobre Responsabilidade de Plataformas Digitais

- Secretaria Nacional do Consumidor (Senacon) – Proteção Digital

Engenheiro, Técnico, com foco em Engenharia de Telecomunicações e sistemas de comunicação via satélite. Casado, Pai de 2 filhos. Cidadão de bem e brasileiro.

https://www.linkedin.com/in/marcos-yunaka/